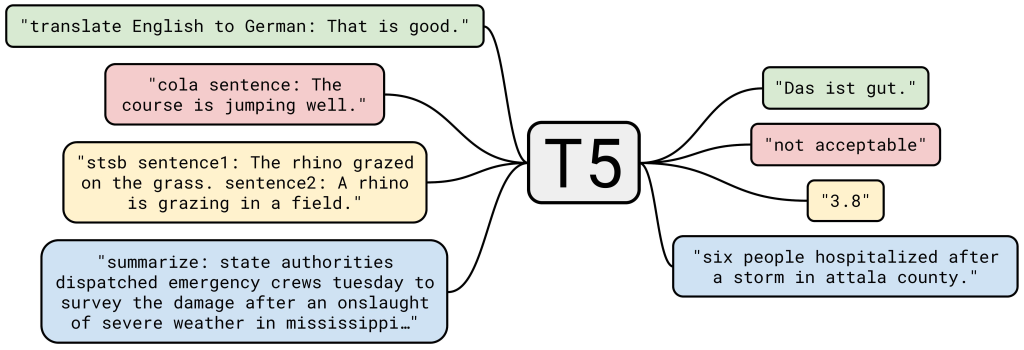

รู้จักกับ T5 Model: Text to Text Transfer Transformer Model

Text-to-Text Transfer Transformer

(ที่มา : 1910.10683.pdf (arxiv.org))

T5 เป็น Pre-train Model ที่มีความสามารถสูงในการประมวลผลภาษาธรรมชาติ สามารถนำไปปรับใช้กับหลายๆงานได้ เช่น การแปลภาษา ทำนายชนิดของคำ เป็นต้น

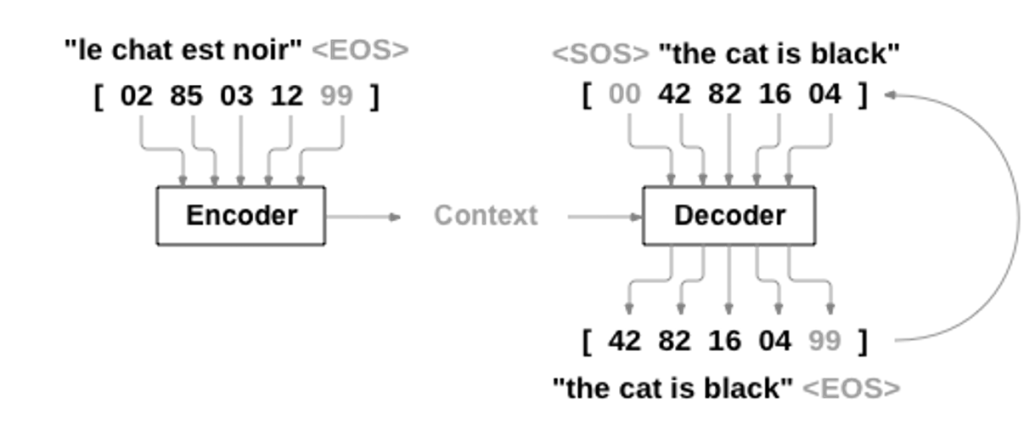

Sequence-to-Sequence ที่เกิดซ้ำสองเครือข่ายทำงานร่วมกันเพื่อแปลงลำดับหนึ่งเป็นอีกลำดับหนึ่ง

(ที่มา : NLP FROM SCRATCH: TRANSLATION WITH A SEQUENCE TO SEQUENCE NETWORK AND ATTENTION)

โดยหลักการของ T5 จะเป็นการทำ Sequence-to-Sequence กับข้อมูลขนาดใหญ่เพื่อให้สามารถสร้างประโยคใหม่แล้วยังรักษาความหมายของประโยคนั้นๆได้ประกอบด้วยสองส่วนหลักๆ คือ Encoder และ Decoder โดยที่ Encoder มีหน้าที่ถอดรหัสข้อความต้นฉบับเป็นลำดับของเวกเตอร์ส่วน Decoder มีหน้าที่แปลงลำดับของเวกเตอร์เป็นข้อความเป้าหมาย

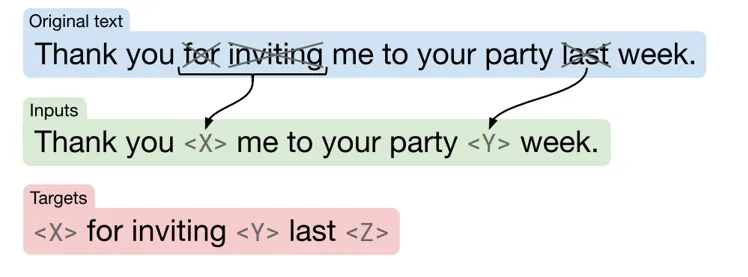

การทำนายคำที่หายไปของ T5

(ที่มา :1910.10683.pdf (arxiv.org))

ในตัวของ T5 ได้มีการ Self-Supervised Pre-train กับประโยคจำนวนมหาศาล โดยจะให้โมเดลเรียนรู้ด้วยการลบข้อความบางส่วนออกจากประโยคประมาณ 15% ของประโยคทั้งหมดและให้โมเดลทำนายข้อความที่หายไปว่าคืออะไร การทำแบบนี้ทำให้ตัวโมเดลมีความสามารถสูงในการเข้าใจภาษาและสามารถทำให้การแปลงข้อความให้เป็นข้อความเป้าหมายได้อย่างแม่นยำ